논문 : https://arxiv.org/pdf/2104.13586.pdf

최근 행동 인식 분야에서 C3D 계열 모델이 높은 성능을 보여서 간단하게 정리를 해보려고 합니다.

논문에서는 행동 인식 분야에서 높은 성능을 보였던 Graph Convolution 기반이 아닌 관절 히트맵을 대상으로 3D Convolution을 진행하여 행동을 인식한다.

논문에서 제안하는 프레임워크의 구조는 다음과 같다.

입력받은 이미지에서 사람을 검출하고, 검출된 영역에 대해서 각 관절의 히트맵을 뽑는다. 각 프레임별로 추출된 히트맵을 쌓아 3D Heatmap Volume을 만들고 Convolution layers를 통과시켜 행동을 분류한다.

3D Heatmap Volume

논문의 핵심이 되는 3D Volume Heatmap은 다음과 같은 수식을 통해 구해진다.

1. 히트맵 데이터의 형태는 K x H x W로 K는 관절의 수, H와 W는 각각 Height와 Width를 나타내며 관절 히트맵 J는 다음과 같이 표현된다.

σ^2은 가우시안 분포의 분산, (xk, yk) ck는 각각 k 번째 관절의 좌표와 신뢰도를 나타낸다.

2. 골격 히트맵 L은 다음과 같이 표현된다.

k는 ak와 bk 사이에 있고 함수 D는 (i, j)와 세그먼트된 [(xak , yak ),(xbk , ybk )] 사이의 거리를 계산한다.

이러한 과정을 통해서 K x T x H x W 크기를 갖는 3D Volume Heatmap을 구한다. 또한 수식은 하나의 객체를 가정으로 작성되었지만 변수를 추가하여 쉽게 다수의 객체에 대해서 처리가 가능하다고 한다.

논문에서 얘기하는 3D Volume Heatmap의 장점은 다음과 같다.

- CNN 구조를 사용하기 때문에 CNN 발전에 영향을 받는다.

- Heatmap 형태를 사용하기 때문에 사람 수가 증가해도 오버헤드가 발생하지 않는다.

- GCN과 달리 관절의 소실이나 흔들림 같은 노이즈에 강인하다.

techniques to reduce the redundancy of 3D heatmap volumes

논문에서는 연산 비용을 줄이기 위하여 다음과 같은 두 가지 기술을 적용하였다.

1. 객체가 없는 공간에 대한 연산을 줄이기 위하여 쌓여진 프레임들에서 등장하는 모든 객체를 감싸는 가장 작은 영역에 대해서만 연산을 진행한다.

2. 영상에서 n개의 프레임을 추출한다고 했을 때 n개의 그룹을 만들고 각 그룹 내에서 무작위로 1개의 프레임을 추출하는 샘플링 전략을 사용한다. 제안하는 샘플링 방식이 고정된 샘플링 방식에 비해 높은 성능을 보이는 것을 확인할 수 있었다고 한다.

Compared to GCN

몇가지 실험을 통해 제안하는 모델이 GCN 기반 모델보다 우수한 성능을 보인다는 것을 확인하고 있다.

1. Performance

테이블 3에서는 제안하는 모델이 더 적은 파라미터를 가지고 비슷하거나 더 높은 정확도를 내는 걸 볼 수 있다.

2. Robustness

테이블 4에서는 확률 p에 따라 임의의 관절을 분리시켰을 때 행동 인식 모델의 정확도를 보여준다. 확률을 높일수록 두 모델간의 성능차이가 커지는 것을 볼 수 있다.

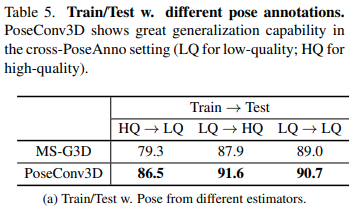

3. Generalization

테이블 5에서는 관절 검출 모델을 교차로 사용했을 때의 성능을 토대로 행동 인식 모델의 일반화 성능을 평가한다. HQ->LQ 부분에서 꽤 큰 성능 차이를 보이는데 이는 더 낮은 품질의 관절 데이터를 제공했을 때의 성능이라는 점에서 위 쪽에서 언급한 Robustness와 연결지어서 생각할 수 있다.

4. Scalability

논문 전체에 걸쳐서 지속적으로 언급되는 부분으로 GCN 기반의 행동 인식 모델의 경우 사람이 1명에서 N명으로 증가할 때 입력 데이터의 크기도 N배 만큼 증가하지만 제안하는 모델의 경우 연산량이 크게 변하지 않는다고 주장한다.

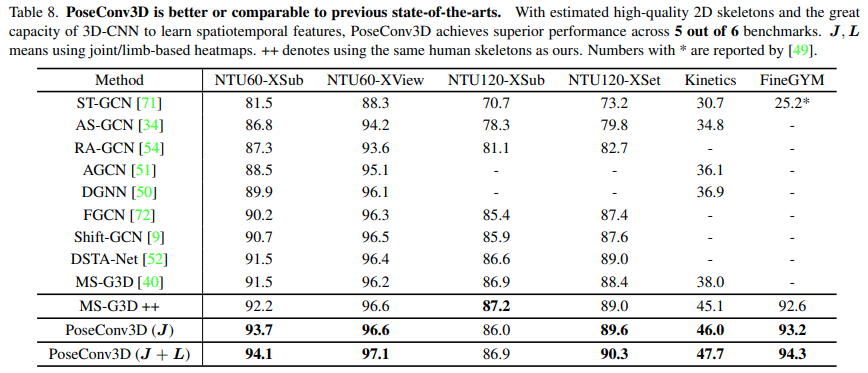

5. SOTA

제안하는 모델은 5개의 벤치마크 데이터셋에 대해서 가장 높은 정확도를 보였으며, 멀티 모달 행동 인식 분야에서는 8개의 벤치마크 데이터셋에 대해서 SOTA를 달성하였다.

'Paper Review' 카테고리의 다른 글

| [Paper Review] YOLO (0) | 2022.11.22 |

|---|---|

| [Paper Review] Faster R-CNN (0) | 2022.11.18 |

| [Paper Review] Fast R-CNN (0) | 2022.11.16 |

| [Paper Review] SPP-Net (0) | 2022.11.11 |

| [Paper Review] R-CNN (0) | 2022.11.10 |